Medidas de dispersión

Las medidas de dispersión, también llamadas medidas de variabilidad, muestran la variabilidad de una distribución, indicando por medio de un número si las diferentes puntuaciones de una variable están muy alejadas de la media. Cuanto mayor sea ese valor, mayor será la variabilidad, y cuanto menor sea, más homogénea será a la media. Así se sabe si todos los casos son parecidos o varían mucho entre ellos.

Para calcular la variabilidad que una distribución tiene respecto de su media, se calcula la media de las desviaciones de las puntuaciones respecto a la media aritmética. Pero la suma de las desviaciones es siempre cero, así que se adoptan dos clases de estrategias para salvar este problema. Una es tomando las desviaciones en valor absoluto (desviación media) y otra es tomando las desviaciones al cuadrado (varianza).

Las medidas de dispersión, también llamadas medidas de variabilidad, muestran la variabilidad de una distribución, indicando por medio de un número si las diferentes puntuaciones de una variable están muy alejadas de la media. Cuanto mayor sea ese valor, mayor será la variabilidad, y cuanto menor sea, más homogénea será a la media. Así se sabe si todos los casos son parecidos o varían mucho entre ellos.

Para calcular la variabilidad que una distribución tiene respecto de su media, se calcula la media de las desviaciones de las puntuaciones respecto a la media aritmética. Pero la suma de las desviaciones es siempre cero, así que se adoptan dos clases de estrategias para salvar este problema. Una es tomando las desviaciones en valor absoluto (desviación media) y otra es tomando las desviaciones al cuadrado (varianza).

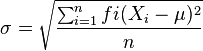

La varianza es una medida estadística que mide la dispersión de los valores respecto a un valor central (media), es decir, es el cuadrado de las desviaciones:

Desviación típica

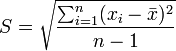

La varianza a veces no se interpreta claramente, ya que se mide en unidades cuadráticas. Para evitar ese problema se define otra medida de dispersión, que es la desviación típica, o desviación estándar, que se halla como la raíz cuadrada positiva de la varianza. La desviación típica informa sobre la dispersión de los datos respecto al valor de la media; cuanto mayor sea su valor, más dispersos estarán los datos. Esta medida viene representada en la mayoría de los casos por S, dado que es su inicial de su nominación en inglés.Desviación típica muestral

Desviación típica poblacional

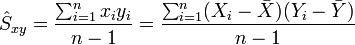

Covarianza

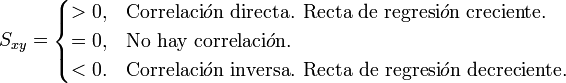

La covarianza entre dos variables es un estadístico resumen indicador de si las puntuaciones están relacionadas entre sí. La formulación clásica se simboliza por la letra griega sigma (σ) cuando ha sido calculada en la población. Si se obtiene sobre una muestra, se designa por la letra " ".La fórmula suele aparecer expresada como:

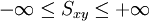

".La fórmula suele aparecer expresada como: Este tipo de estadístico puede utilizarse para medir el grado de relación de dos variables si ambas utilizan una escala de medida a nivel de intervalo/razón (variables cuantitativas).La expresión se resuelve promediando el producto de las puntuaciones diferenciales por su tamaño muestral (n pares de puntuaciones, n-1 en su forma insesgada).Este estadístico refleja la relación lineal que existe entre dos variables. El resultado numérico fluctúa entre los rangos de +infinito a -infinito. Al no tener unos límites establecidos no puede determinarse el grado de relación lineal que existe entre las dos variables, solo es posible ver la tendencia.

Este tipo de estadístico puede utilizarse para medir el grado de relación de dos variables si ambas utilizan una escala de medida a nivel de intervalo/razón (variables cuantitativas).La expresión se resuelve promediando el producto de las puntuaciones diferenciales por su tamaño muestral (n pares de puntuaciones, n-1 en su forma insesgada).Este estadístico refleja la relación lineal que existe entre dos variables. El resultado numérico fluctúa entre los rangos de +infinito a -infinito. Al no tener unos límites establecidos no puede determinarse el grado de relación lineal que existe entre las dos variables, solo es posible ver la tendencia.

}

}

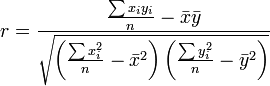

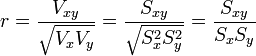

Coeficiente de Correlación de Pearson

El coeficiente de correlación de Pearson, r, permite saber si el ajuste de la nube de puntos a la recta de regresión obtenida es satisfactorio. Se define como el cociente entre la covarianza y el producto de las desviaciones típicas (raíz cuadrada de las varianzas).Teniendo en cuenta el valor de la covarianza y las varianzas, se puede evaluar mediante cualquiera de las dos expresiones siguientes:Ejemplo Para una muestra de valores (3, 3, 5, 6, 8), el dato de menor valor Min= 3 y el dato de mayor valor Max= 8. El medio rango resolviéndolo mediante la correspondiente fórmula sería:

![r = \frac{n\sum x_i y_i - \sum x_i \sum y_i}

{\sqrt{\left[n\sum x_i^2 - \left(\sum x_i\right)^2\right]

\left[n\sum y_i^2 - \left(\sum y_i\right)^2\right]}}](https://upload.wikimedia.org/math/b/e/4/be488bef1d6bcebdbe222fe7a551cdcf.png)

No hay comentarios.:

Publicar un comentario